1. מבוא

העדכון האחרון: 8 בפברואר 2022

למה צריך סטרימינג מריבוי עננים?

עסקים מחפשים באופן פעיל לפזר את עומסי העבודה שלהם על פלטפורמות ענן מרובות, כי יש כמה יתרונות לאימוץ של כמה ספקי ענן בתהליך העבודה התפעולי של העסק, כמו:

- נעילת ספק

- צמצום הסיכון להמשכיות עסקית

- יחסי תלות והסתמכות על סטאק טכנולוגיות אחד

מה תפַתחו

ב-Codelab הזה תלמדו איך להגדיר העברת נתונים בזמן אמת בין כמה עננים – AWS ו-GCP – באמצעות Confluent Cloud. תצטרכו:

- הגדרת אשכול Kafka ייעודי ב-Confluent Cloud ב-GCP.

- מגדירים קישור בין רשתות שכנות של VPC בין Confluent Cloud לבין פרויקט GCP, כדי שאפשר יהיה לגשת אליו ברשת פרטית.

- מגדירים מנהרת VPN בין פרויקט AWS לפרויקט GCP כדי שהמשאבים בשני ספקי הענן יוכלו להתחבר.

- גישה ל-Confluent Kafka מ-AWS והגדרה של פייפליין סטרימינג מ-AWS ל-GCP באמצעות Confluent Kafka Cloud.

מה תלמדו

- איך מגדירים קישור בין רשתות VPC שכנות (peering) בין Confluent Cloud Kafka לבין פרויקט GCP.

- איך מגדירים מנהרת VPN בין פרויקטים ב-AWS וב-GCP.

- איך לגשת ל-Confluent Cloud שמתארח ב-GCP מפרויקט AWS.

ה-Codelab הזה מתמקד ביצירת סטרימינג של נתונים בכמה עננים. מושגים ובלוקים של קוד שלא רלוונטיים מוצגים בקצרה, ואתם יכולים פשוט להעתיק ולהדביק אותם.

מה תצטרכו

- גישה לפרויקט ב-AWS.

- גישה לפרויקט GCP.

- ניסיון ב-GCP וב-AWS Cloud.

- מינוי ל-Confluent Kafka מ-GCP Marketplace.

2. תהליך ההגדרה

הגדרת חיבור ה-VPN בין AWS ל-GCP

- בהדגמה הזו נעשה שימוש ב-VPC שמוגדר כברירת מחדל (asia-southeast1) ב-GCP וב-ng-vpc-103-mum (ap-south1) ב-AWS.

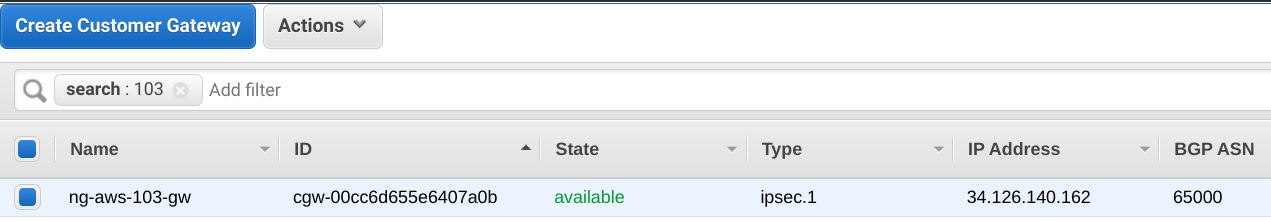

- ב-AWS, יוצרים את Customer Gateway ואת Virtual Private Gateway (VPG). מצרפים את ה-VPG ל-AWS VPC.

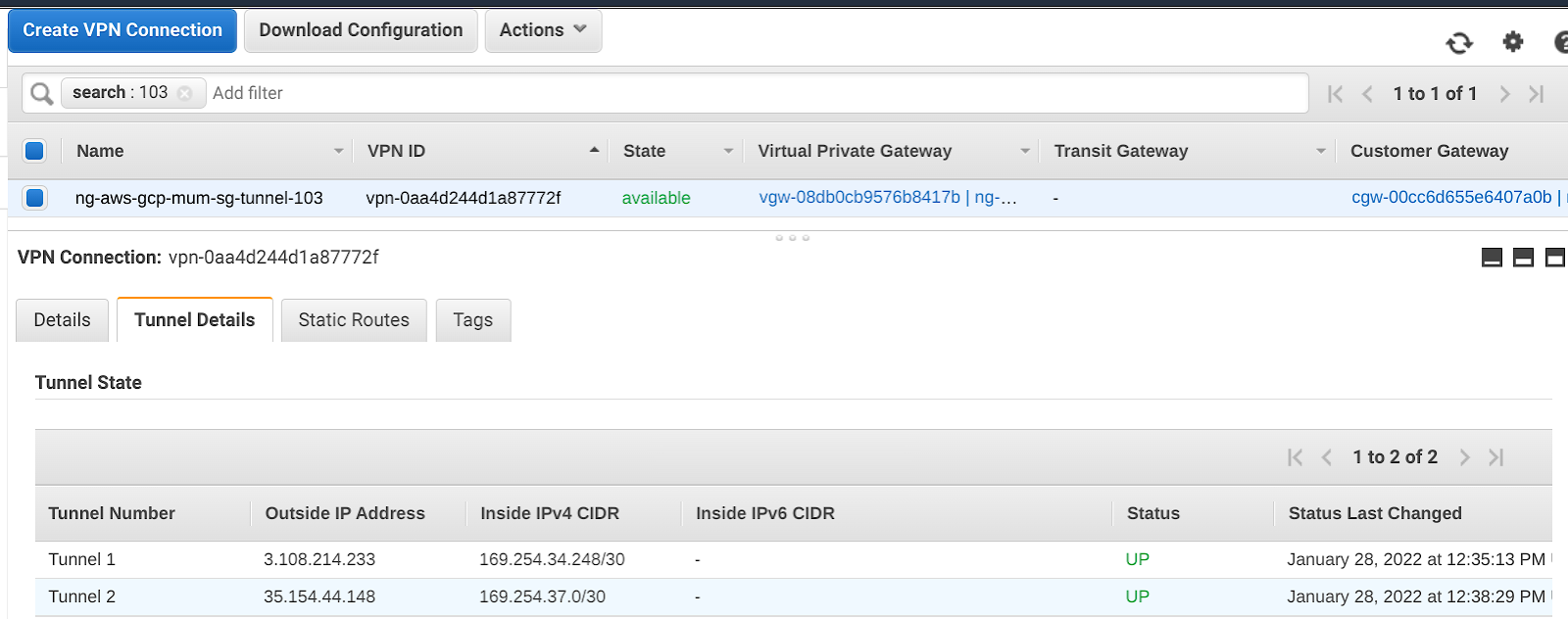

- יוצרים את חיבור ה-VPN בין האתרים ב-AWS.

- מורידים את קובץ התצורה של המנהרה שנוצרה ב-AWS. בחירה

- ספק : כללי

- פלטפורמה : כללית

- תוכנה : לא תלויה בספק

- גרסת Ike : Ikev2

- יוצרים את שער ה-VPN ואת מנהרת ה-VPN ב-GCP.

מזינים את כתובת ה-IP ואת מפתח Ikev2 מקובץ התצורה של AWS שהורד עבור שתי המנהרות.

- בסיום, המנהרה אמורה להיות פעילה ב-AWS וב-GCP.

הגדרת המנהרה הושלמה.

- בוחרים בלוק CIDR שישמש להגדרת Confluent Cloud. מוסיפים את זה למנהרת ה-VPN כנתיב סטטי ב-AWS.

Confluent Kafka בזירת המסחר של GCP

- נרשמים למינוי Confluent Kafka מ-GCP Marketplace.

- מתחברים ל-Confluent Cloud ויוצרים אשכול ייעודי

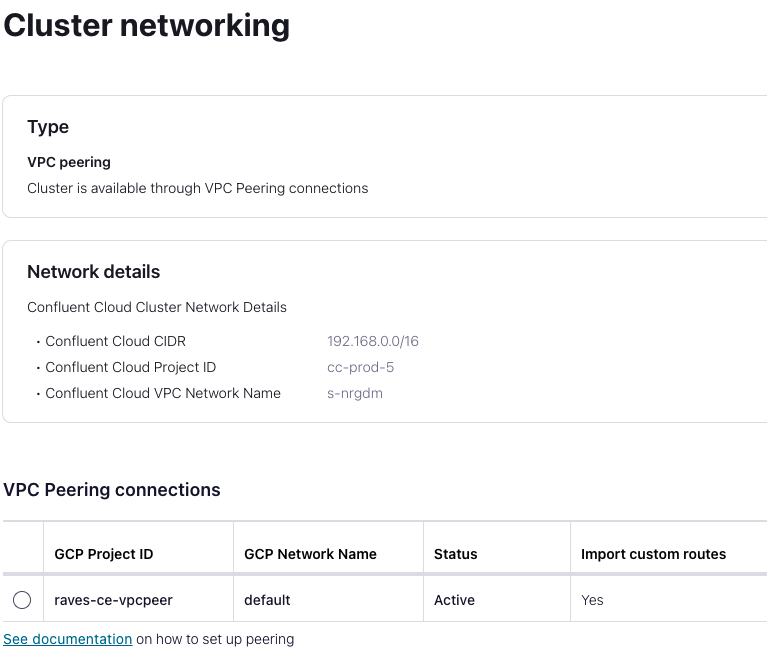

- צריך לספק את מזהה הפרויקט ב-GCP יחד עם פרטי רשת ה-VPC לקישור.

- משלימים את הקישור בין רשתות שכנות ב-GCP באמצעות פרטי רשת האשכול של Confluent Cloud שסופקו.

- האשכול Confluent Cloud פעיל ומקושר ל-GCP עכשיו.

- בודקים את הקישוריות ל-Confluent Cluster מ-GCP.

- יוצרים מופע GCE ומתקינים את Python3.

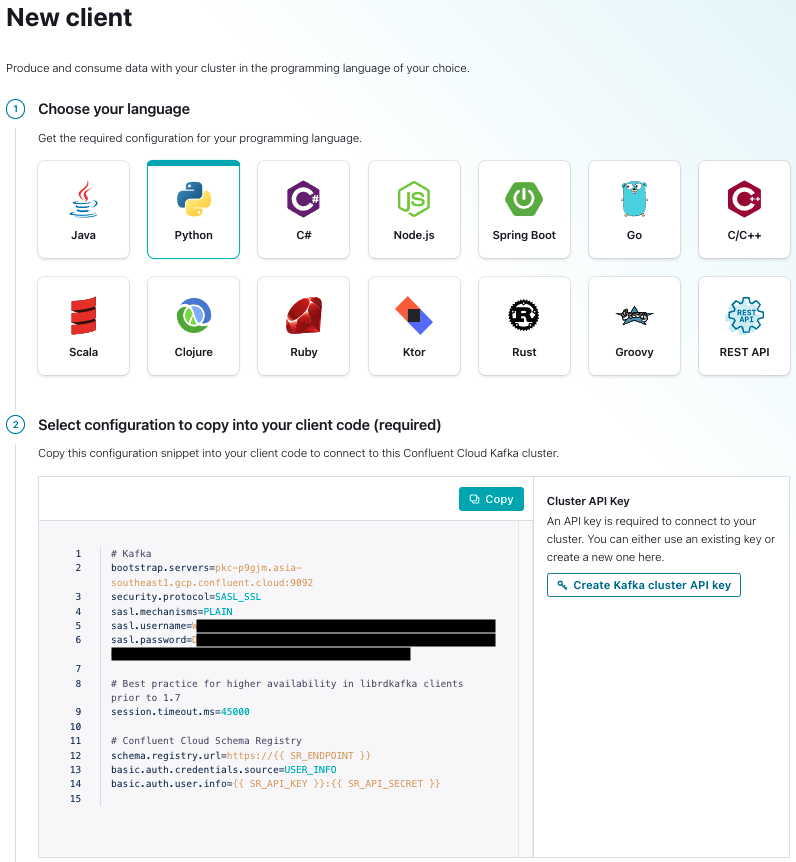

- יצירת מפתח לקוח Python ב-Confluent Cloud

- מריצים את סקריפט הבדיקה producer.py ממופע GCP:

- עכשיו מורידים את בסיס הקוד לדוגמה במכונת ה-AWS ומריצים את הסקריפט producer.py כדי לבדוק את הקישוריות ההיברידית ל-Confluent Cloud מ-GCP.

3. מזל טוב

הצלחתם לבנות פלטפורמת סטרימינג של Confluent Kafka מרובת עננים וחוצת אזורים בין AWS לבין GCP.

האם ה-Codelabs האלה היו מועילים?**?**

כדאי לעיין ב-Codelabs הבאים…